Разберете Своя Номер На Ангел

Етика на AI: Как търговците трябва да приемат иновациите отговорно

Изкуственият интелект (AI) не е просто научно-фантастичен феномен, превърнал се в реалност – това е технологична опора, разработвана в продължение на десетилетия точно под носа ни. AI осъществи мечтите за повишена ефективност, като много марки вече се възползват AI маркетинг през последните няколко години.

Въпреки че предизвика вълнение и ентусиазъм, има опасения около етиката на ИИ. Подобно на много иновации, визията на технологичната индустрия за метавселената имаше зловещи прилики с медии като Black Mirror и Snow Crash . И с произведения като „Притчата за сеяча, машината и аз, роботът“ в рамките на културния дух на времето е разбираемо защо феновете на научната фантастика, изследователите и технолозите предупреждават за опасностите от пренебрегването на етиката на ИИ.

В тази статия ще дефинираме какво представлява етиката на ИИ, защо марките трябва да бъдат загрижени и основните етични проблеми, пред които са изправени търговците, включително сигурността на работата, дезинформацията и алгоритмичните пристрастия. Също така ще споделим пет стъпки, за да ви помогнем да поддържате етични AI практики в екипите и в цялата организация.

Какво представлява етиката на ИИ?

Етиката на AI е система от морални принципи и професионални практики, използвани за отговорно информиране на развитието и резултатите от технологията за изкуствен интелект. Също така се отнася до проучването как да се оптимизира въздействието и да се намалят рисковете и/или последствията от ИИ.

Водещи технологични компании, правителствени организации като Организацията на обединените нации и изследователски и научни общности работиха за оформяне и публикуване на насоки за справяне с етични проблеми. Например Организацията на обединените нации за образование, наука и култура (ЮНЕСКО) публикува първия глобален стандарт за етиката на ИИ през ноември 2021 г.: Препоръка за етиката на изкуствения интелект .

Съществуват някои регулации за ИИ на национално и местно ниво, но тъй като ИИ и другите нововъзникващи технологии растат, фирмите трябва да очакват повече правителствени регулации. Тъй като AI се интегрира все повече в живота ни, етиката на AI се превръща в критична част от цифровата грамотност.

69 ангелски числа в смисъл

Защо етиката на ИИ има значение

Компаниите вече инвестират в AI, но трудността е да се осигури отговорна употреба.

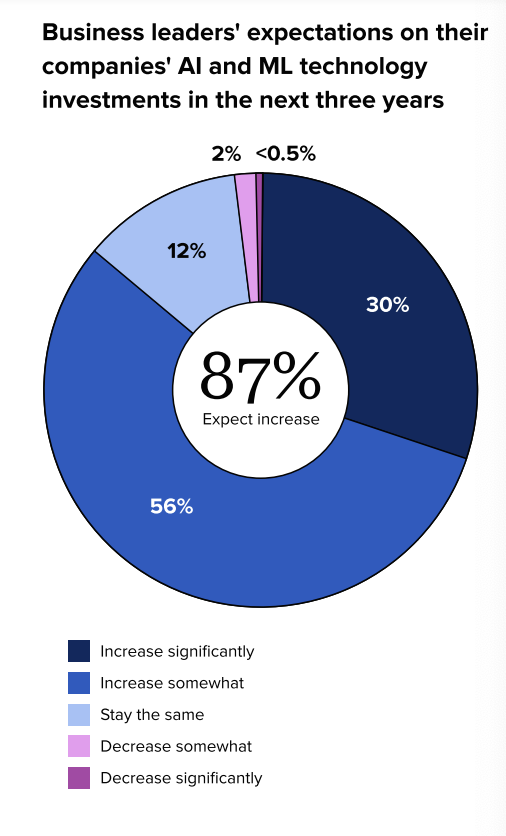

Според Състоянието на социалните медии през 2023 г.: AI и данните заемат централно място доклад, бизнес лидерите очакват увеличени инвестиции в AI през следващите няколко години. Нашият доклад също установи, че 98% от бизнес лидерите са съгласни, че компаниите трябва да разберат по-добре потенциала на AI и технологията за машинно обучение (ML) за дългосрочен успех.

Въпреки че изкуственият интелект може да подобри производителността, да повиши ефективността и да генерира положителни бизнес резултати, марките също изпитват непредвидени последици от приложението му. Това може да произтича от липса на изследвания или пристрастни набори от данни, наред с други причини. Злоупотребата с изкуствен интелект или пренебрегването на етични съображения може да доведе до накърнена репутация на марката, неизправности на продуктите, съдебни спорове и регулаторни проблеми.

Първата стъпка към спазването на етичните стандарти в екипите във вашата организация започва с разбирането на проблемите, пред които са изправени търговците, така че можете да оформите план за смекчаване на тези бизнес рискове и защита на вашата марка.

Какви проблеми с етиката на изкуствения интелект са най-важните за търговците

В технологичната индустрия има различни етични опасения, свързани с ИИ, включително, но не само, следното:

- Генериране на фалшиво съдържание

- Обяснимост

- Обществено въздействие

- Злоупотреба с технологии

- Пристрастие

- Отговорност и поверителност на данните

- Справедливост

- Здравина

- Прозрачност

- Екологична устойчивост

- Разнообразие и включване

- Морална свобода на избор и ценностно подреждане

- Доверие и отчетност

Някои вярват, че AI може да помогне за изграждането на по-приобщаващи технологии, системи и услуги, които могат да се погрижат за различни групи от населението. Ключът е да се установят етични рамки, разпоредби и механизми, за да се гарантира отговорна употреба.

Член на дендрариумът , форум на общността на Sprout, отбеляза, че AI има потенциала да насърчава приобщаването и да намалява пристрастията/дискриминацията чрез осигуряване на справедливи, безпристрастни процеси на вземане на решения. Чрез справяне с въпроси като алгоритмични пристрастия при разработването на ИИ може да бъде възможно да се оформи бъдеще, в което ИИ е положителна сила на промяната.

Наред с потенциала за положителна промяна, има и възможности за злоупотреба или неетична употреба на AI, тъй като той става по-мощен. Нашата общност обсъди няколко риска, включително нарушаване на поверителността, манипулиране на общественото мнение и автономни оръжия.

Коментари като тези просто надраскват повърхността на етичните опасения в различните индустрии, но най-важните проблеми за търговците включват: сигурност на работата, неприкосновеност на личния живот, пристрастия и дискриминация, дезинформация и дезинформация и проблеми с интелектуалната собственост/авторските права, които ще разгледаме подробно в следващия раздел.

Въздействие върху работните места и изместване на работа

Роботите, осигуряващи световно господство, са най-малката ни грижа - поне засега.

И това е така, защото изследователите и експертите не са застрашени от технологична уникалност , или идеята, че AI ще надмине човешкия интелект и ще възпроизведе черти като социални умения. Те са наясно с ограниченията на ИИ и потенциалните последици от смяна на работа.

Целта на изследването и инвестиране в AI не е да замени хората - това е да ни помогне да спестим време и усилия, за да правим по-въздействащи неща. Директор социални медии и партньорства на Flock Freight, Боб Улфли сподели страхотна аналогия за AI : „ИИ е като съдомиялната или пералнята в домовете ни. Помислете за цялото време, което спестявате, като не миете съдове или дрехи на ръка.

В нашата поредица Unread членовете на маркетинговия и творчески екип на Sprout обсъдиха как в момента използват AI, от отдаването на персонализирано пазаруване до използването на функции като ViralPost® за подпомагане на планирането на социални публикации. Гледайте видеоклипа по-долу, за да чуете техните горещи мнения относно предимствата и страховете на AI, включително смяна на работа:

Загриженост за поверителността

Притесненията около поверителността на данните, защитата и сигурността са най-важните за марките. Инвестициите в сигурността са все по-голям приоритет за бизнеса, тъй като те се стремят да избегнат всякакви възможности за наблюдение, хакерство и кибератаки. Тъй като персонализирането става все по-популярно, марките прилагат най-добрите практики за събиране, съхраняване и анализиране на данни, за да защитят клиенти и организации.

Алгоритмично отклонение и дискриминация

Тъй като се учи от данни, лошо конструиран или обучен AI може да демонстрира пристрастия срещу недостатъчно представени подгрупи от данни. Има няколко големи случая на пристрастия с произведения на изкуството, генерирани от AI, чатботове, софтуер за разпознаване на лица, алгоритми и инструменти за AI за практики за наемане .

Например, няколко потребители на TikTok и Twitter [ребрандирани на X от юли 2023 г.] извикаха тема, включваща „#SouthSudan Barbie“, украсена с оръжия, негативен стереотип, свързан с регион, борещ се със социално-политически проблеми като геноцид и бежански кризи .

Тъй като пристрастията навлизат в още по-ниски залози, AI използва случаи като този, възниква въпросът как да работим срещу пристрастията и дискриминацията, когато наборите от данни за обучение могат да се поддават на пристрастия?

Дезинформация и дезинформация

Подобно на хората, AI не е съвършен. Отговорите на AI на подкани може да са неточни и има опасения, че хората разпространяват дезинформация със злонамерени намерения. Наред със заплахите от дезинформация, има потенциал за криза на марката и увреждане на репутацията, особено без подходящи предпазни мерки и протоколи.

Проблеми с интелектуалната собственост и авторските права

Вероятно сте виждали актьорите от Хари Потър като герои във филм на Уес Андерсън или гражданите на Бикини Ботъм, които пеят интерпретации на популярни песни. Това са примери за това колко хора използват AI, за да използват образа и подобието на хората или интелектуалната собственост.

AI е отличен спаринг партньор за творчески задачи като мозъчна атака и създаване на контури, но в зависимост от това как се използват резултатите, това може да доведе до нарушаване на авторски права, плагиатство и нарушения на интелектуалната собственост. Например група художници заведе дело срещу Midjourney и Stability AI през януари 2023 г., твърдейки, че инструментите нарушават правата на милиони творци. Generative AI отваря легална кутия с червеи и все още има много поле за покриване, но създаването на проактивни правила и рамки ще помогне за смекчаване на етичните рискове.

5 стъпки за поддържане на етиката на ИИ в екипите

Ето пет стъпки, които да ви помогнат да ръководите плана си за смекчаване на етичните рискове, свързани с ИИ:

1. Установете вътрешни основни правила и отговорности за използването на AI

Помислете за създаване на екип по етика на ИИ от етика, правни експерти, технолози и лидери, които да помогнат за установяването на основни правила за вашата организация. Например използването на генериращ AI само за чернови и мозъчна атака, но не и за външно публикувано съдържание, е отлично основно правило.

Заедно с тези основни правила, определете ролята и отговорностите на всеки член на екипа, участващ в ИИ, включително екипа по етика. Задайте своите цели и ценности и за AI. Това ще ви помогне да поставите основата за вашата етична политика и най-добри практики за AI.

2. Определете и одитирайте ролята на ИИ

AI не може да замени създателите на съдържание, стратезите в социалните медии или каквато и да е роля в маркетинга. Идентифицирайте задачите на AI, които изискват човешки надзор или намеса, и посочете целите на вашата етична политика за AI, за да помогнете за разработването на процеси за разработване, управление и комуникация относно AI.

След като идентифицирате целите на вашата етична политика, идентифицирайте пропуските и възможностите за AI във вашата организация. Обмислете следните въпроси:

- Как организацията използва AI в момента и как искаме да го използваме в бъдеще?

- Какъв софтуер и анализ могат да ни помогнат да намалим бизнес рисковете?

- Какви пропуски създават технологията и анализът? Как да ги напълним?

- Какви тестове или експерименти трябва да проведем?

- Какви съществуващи решения можем да използваме с настоящите най-добри практики за нашите продуктови екипи?

- Как ще използвате данните и прозренията?

- Как ще установим позициониране на нашата марка и послания за AI технологии и етика?

3. Разработете херметичен процес за оценка на доставчика

Партньорствайте с вашите ИТ и юридически екипи, за да проверите правилно всички инструменти с възможности на AI и да установите процес за етичен риск. Техният опит ще ви помогне да оцените нови съображения, като например набора от данни, върху който се обучава даден инструмент, и контролите, които доставчиците разполагат, за да смекчат пристрастията на AI. Процесът на надлежна проверка за всеки инструмент преди пускането му външно или вътрешно ще ви помогне да намалите бъдещите рискове.

4. Поддържайте прозрачност с оповестявания

Сътрудничете с вашите правни екипи и/или екипи по поверителност, за да разработите външни съобщения и/или откази от отговорност, за да посочите къде и кога вашата марка разчита на AI. Тези съобщения могат да се използват за съдържание, обслужване на клиенти и т.н. Например TikTok актуализира своите насоки на общността да изискват от създателите да обозначават съдържание, генерирано от AI. Комуникирането на вашите етични стандарти и рамки за защита на етиката на ИИ ще ви помогне да спечелите доверието на колеги, потенциални клиенти и клиенти.

5. Продължете обучението на ръководството и екипите

AI не е нещо бизнес лидерство може да се втурне. Като всяка нова вълна от нововъзникващи иновации, ще има крива на обучение, на върха на новите технологични етапи. Помогнете за изравняване на условията на игра, като организирате вътрешни обучения и семинари, за да обучите всички членове на екипа, лидери и заинтересовани страни относно етиката на ИИ и как да я изграждате отговорно.

Направете правилното нещо с етиката на ИИ

Разглеждането на етиката не е просто правилното нещо – то е критичен компонент от използването на AI технологията в бизнеса.

Научете повече гледни точки от лидери и търговци за това как AI ще повлияе на бъдещето на социалните мрежи в нашата уебинар, заедно с други констатации от Доклада за състоянието на социалните медии за 2023 г. и съвети за създаване на въздействащо социално съдържание.

Споделете С Приятелите Си:

![Отговор на потребител на генерирана от AI снимка на „#SouthSudan Barbie“ в нишка в Twitter [ребрандирана на X от юли 2023 г.]. Публикацията гласи: „Продължаваме да казваме на y'all that bias is built into this AI-generated garbage."](https://clarksbarandrestaurant.com/img/all-marketing-insights/C2/ai-ethics-how-marketers-should-embrace-innovation-responsibly-3.png)